Facebook、Amazon、Ahrefs、Semrush等这些不会给我们带来流量的平台,它们的爬虫占用大量服务器的资源,这个很让人感到恶心!

Facebook、Amazon这些是把数据拿去训练AI大模型的,Semrush这个就更恶心了,爬数据拿去卖,帮人做SEO,网站服务器太多,直接设置整个服务器封禁这些爬虫的UA。

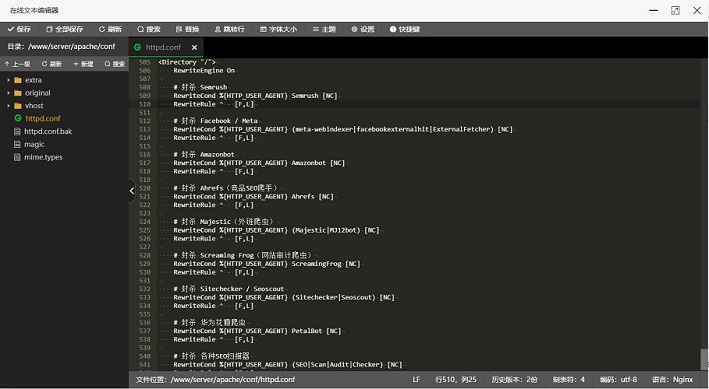

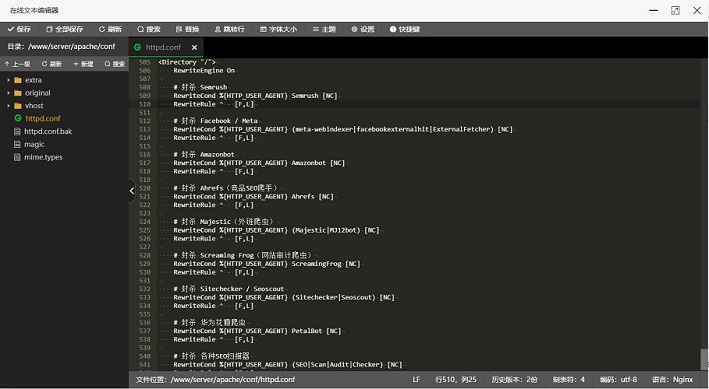

1、找到文件httpd.conf,宝塔面板的一般在/www/server/apache/conf/文件夹下;

2、打开文件,在最后一行加上:

<Directory “/”>RewriteEngine On# 封杀 SemrushRewriteCond %{HTTP_USER_AGENT} Semrush [NC]RewriteRule ^ – [F,L]# 封杀 Facebook / MetaRewriteCond %{HTTP_USER_AGENT} (meta-webindexer|facebookexternalhit|ExternalFetcher) [NC]RewriteRule ^ – [F,L]# 封杀 AmazonbotRewriteCond %{HTTP_USER_AGENT} Amazonbot [NC]RewriteRule ^ – [F,L]# 封杀 Ahrefs(竞品SEO爬手)RewriteCond %{HTTP_USER_AGENT} Ahrefs [NC]RewriteRule ^ – [F,L]# 封杀 Majestic(外链爬虫)RewriteCond %{HTTP_USER_AGENT} (Majestic|MJ12bot) [NC]RewriteRule ^ – [F,L]# 封杀 Screaming Frog(网站审计爬虫)RewriteCond %{HTTP_USER_AGENT} ScreamingFrog [NC]RewriteRule ^ – [F,L]# 封杀 Sitechecker / SeoscoutRewriteCond %{HTTP_USER_AGENT} (Sitechecker|Seoscout) [NC]RewriteRule ^ – [F,L]# 封杀 华为花瓣爬虫RewriteCond %{HTTP_USER_AGENT} PetalBot [NC]RewriteRule ^ – [F,L]# 封杀 各种SEO扫描器RewriteCond %{HTTP_USER_AGENT} (SEO|Scan|Audit|Checker) [NC]RewriteRule ^ – [F,L]</Directory>3、重启Apache,然后看日志,就会出现一堆403,这个都是正常的。

后面这些爬虫会越来越少,但是不会立刻死心,还会是不是的来爬,都会返回403,不加载php和MySQL,对服务器压力减小90%!

打赏

支付宝微信扫一扫,打赏作者吧~

本文链接:https://kinber.cn/post/6464.html 转载需授权!

推荐本站淘宝优惠价购买喜欢的宝贝:

您阅读本篇文章共花了:

您阅读本篇文章共花了:

支付宝微信扫一扫,打赏作者吧~

支付宝微信扫一扫,打赏作者吧~