GitChat 作者:鸣宇淳

原文: 史上最详细的Hadoop环境搭建

关注公众号:GitChat 技术杂谈,一本正经的讲技术

【不要错过文末活动哦】

前言

Hadoop在大数据技术体系中的地位至关重要,Hadoop是大数据技术的基础,对Hadoop基础知识的掌握的扎实程度,会决定在大数据技术道路上走多远。

这是一篇入门文章,Hadoop的学习方法很多,网上也有很多学习路线图。本文的思路是:以安装部署Apache Hadoop2.x版本为主线,来介绍Hadoop2.x的架构组成、各模块协同工作原理、技术细节。安装不是目的,通过安装认识Hadoop才是目的。

本文分为五个部分、十三节、四十九步。

第一部分:Linux环境安装

Hadoop是运行在Linux,虽然借助工具也可以运行在Windows上,但是建议还是运行在Linux系统上,第一部分介绍Linux环境的安装、配置、Java JDK安装等。

第二部分:Hadoop本地模式安装

Hadoop本地模式只是用于本地开发调试,或者快速安装体验Hadoop,这部分做简单的介绍。

第三部分:Hadoop伪分布式模式安装

学习Hadoop一般是在伪分布式模式下进行。这种模式是在一台机器上各个进程上运行Hadoop的各个模块,伪分布式的意思是虽然各个模块是在各个进程上分开运行的,但是只是运行在一个操作系统上的,并不是真正的分布式。

第四部分:完全分布式安装

完全分布式模式才是生产环境采用的模式,Hadoop运行在服务器集群上,生产环境一般都会做HA,以实现高可用。

第五部分:Hadoop HA安装

HA是指高可用,为了解决Hadoop单点故障问题,生产环境一般都做HA部署。这部分介绍了如何配置Hadoop2.x的高可用,并简单介绍了HA的工作原理。

安装过程中,会穿插简单介绍涉及到的知识。希望能对大家有所帮助。

第一部分:Linux环境安装

第一步、配置Vmware NAT网络

一、Vmware网络模式介绍

参考:http://blog.csdn.net/collection4u/article/details/14127671

二、NAT模式配置

NAT是网络地址转换,是在宿主机和虚拟机之间增加一个地址转换服务,负责外部和虚拟机之间的通讯转接和IP转换。

我们部署Hadoop集群,这里选择NAT模式,各个虚拟机通过NAT使用宿主机的IP来访问外网。

我们的要求是集群中的各个虚拟机有固定的IP、可以访问外网,所以进行如下设置:

1、 Vmware安装后,默认的NAT设置如下:

十七、配置、启动YARN

十七、配置、启动YARN

1、 配置mapred-site.xml

默认没有mapred-site.xml文件,但是有个mapred-site.xml.template配置模板文件。复制模板生成mapred-site.xml。

[hadoop@bigdata-senior01 hadoop-2.5.0]# cp etc/hadoop/mapred-site.xml.template etc/hadoop/mapred-site.xml1

添加配置如下:

<property><name>mapreduce.framework.name</name><value>yarn</value></property>1234

指定mapreduce运行在yarn框架上。

第八步、完全布式环境部署Hadoop

第八步、完全布式环境部署Hadoop

完全分部式是真正利用多台Linux主机来进行部署Hadoop,对Linux机器集群进行规划,使得Hadoop各个模块分别部署在不同的多台机器上。

二十五、环境准备

1、 克隆虚拟机

2、 配置网络

修改网卡名称:

在BigData02和BigData03机器上编辑网卡信息。执行sudo vim /etc/udev/rules.d/70-persistent-net.rules命令。因为是从BigData01机器克隆来的,所以会保留BigData01的网卡eth0,并且再添加一个网卡eth1。并且eth0的Mac地址和BigData01的地址是一样的,Mac地址不允许相同,所以要删除eth0,只保留eth1网卡,并且要将eth1改名为eth0。将修改后的eth0的mac地址复制下来,修改network-scripts文件中的HWADDR属性。

sudo vim /etc/sysconfig/network-scripts/ifcfg-eth01

修改网络参数:

BigData02机器IP改为192.168.100.12

BigData03机器IP改为192.168.100.13

3、 配置Hostname

BigData02配置hostname为 bigdata-senior02.chybinmy.com

BigData03配置hostname为 bigdata-senior03.chybinmy.com

4、 配置hosts

BigData01、BigData02、BigData03三台机器hosts都配置为:

[hadoop@bigdata-senior01 hadoop-2.5.0]$ sudo vim /etc/hosts192.168.100.10 bigdata-senior01.chybinmy.com192.168.100.12 bigdata-senior02.chybinmy.com192.168.100.13 bigdata-senior03.chybinmy.com1234

5、 配置Windows上的SSH客户端

在本地Windows中的SSH客户端上添加对BigData02、BigData03机器的SSH链接。

二十六、服务器功能规划

| bigdata-senior01.chybinmy.com | bigdata-senior02.chybinmy.com | bigdata-senior03.chybinmy.com |

|---|

| NameNode | ResourceManage |

|

| DataNode | DataNode | DataNode |

| NodeManager | NodeManager | NodeManager |

| HistoryServer |

| SecondaryNameNode |

二十七、在第一台机器上安装新的Hadoop

为了和之前BigData01机器上安装伪分布式Hadoop区分开来,我们将BigData01上的Hadoop服务都停止掉,然后在一个新的目录/opt/modules/app下安装另外一个Hadoop。

我们采用先在第一台机器上解压、配置Hadoop,然后再分发到其他两台机器上的方式来安装集群。

6、 解压Hadoop目录:

[hadoop@bigdata-senior01 modules]$ tar -zxf /opt/sofeware/hadoop-2.5.0.tar.gz -C /opt/modules/app/1

7、 配置Hadoop JDK路径修改hadoop-env.sh、mapred-env.sh、yarn-env.sh文件中的JDK路径:

export JAVA_HOME="/opt/modules/jdk1.7.0_67"1

8、 配置core-site.xml

[hadoop@bigdata-senior01 hadoop-2.5.0]$ vim etc/hadoop/core-site.xml1

<configuration><property><name>fs.defaultFS</name><value>hdfs://bigdata-senior01.chybinmy.com:8020</value></property><property><name>hadoop.tmp.dir</name><value>/opt/modules/app/hadoop-2.5.0/data/tmp</value></property></configuration>12345678910

fs.defaultFS为NameNode的地址。

hadoop.tmp.dir为hadoop临时目录的地址,默认情况下,NameNode和DataNode的数据文件都会存在这个目录下的对应子目录下。应该保证此目录是存在的,如果不存在,先创建。

9、 配置hdfs-site.xml

[hadoop@bigdata-senior01 hadoop-2.5.0]$ vim etc/hadoop/hdfs-site.xml1

<configuration><property><name>dfs.namenode.secondary.http-address</name><value>bigdata-senior03.chybinmy.com:50090</value></property></configuration>123456

dfs.namenode.secondary.http-address是指定secondaryNameNode的http访问地址和端口号,因为在规划中,我们将BigData03规划为SecondaryNameNode服务器。

所以这里设置为:bigdata-senior03.chybinmy.com:50090

10、 配置slaves

[hadoop@bigdata-senior01 hadoop-2.5.0]$ vim etc/hadoop/slavesbigdata-senior01.chybinmy.combigdata-senior02.chybinmy.combigdata-senior03.chybinmy.com1234

slaves文件是指定HDFS上有哪些DataNode节点。

11、 配置yarn-site.xml

[hadoop@bigdata-senior01 hadoop-2.5.0]$ vim etc/hadoop/yarn-site.xml1

<property><name>yarn.nodemanager.aux-services</name><value>mapreduce_shuffle</value></property><property><name>yarn.resourcemanager.hostname</name><value>bigdata-senior02.chybinmy.com</value></property><property><name>yarn.log-aggregation-enable</name><value>true</value></property><property><name>yarn.log-aggregation.retain-seconds</name><value>106800</value></property>12345678910111213141516

根据规划yarn.resourcemanager.hostname这个指定resourcemanager服务器指向bigdata-senior02.chybinmy.com。

yarn.log-aggregation-enable是配置是否启用日志聚集功能。

yarn.log-aggregation.retain-seconds是配置聚集的日志在HDFS上最多保存多长时间。

12、 配置mapred-site.xml

从mapred-site.xml.template复制一个mapred-site.xml文件。

[hadoop@bigdata-senior01 hadoop-2.5.0]$ cp etc/hadoop/mapred-site.xml.template etc/hadoop/mapred-site.xml1

<configuration><property><name>mapreduce.framework.name</name><value>yarn</value></property><property><name>mapreduce.jobhistory.address</name><value>bigdata-senior01.chybinmy.com:10020</value></property><property><name>mapreduce.jobhistory.webapp.address</name><value>bigdata-senior01.chybinmy.com:19888</value></property></configuration>1234567891011121314

mapreduce.framework.name设置mapreduce任务运行在yarn上。

mapreduce.jobhistory.address是设置mapreduce的历史服务器安装在BigData01机器上。

mapreduce.jobhistory.webapp.address是设置历史服务器的web页面地址和端口号。

二十八、设置SSH无密码登录

Hadoop集群中的各个机器间会相互地通过SSH访问,每次访问都输入密码是不现实的,所以要配置各个机器间的

SSH是无密码登录的。

1、 在BigData01上生成公钥

[hadoop@bigdata-senior01 hadoop-2.5.0]$ ssh-keygen -t rsa1

一路回车,都设置为默认值,然后再当前用户的Home目录下的.ssh目录中会生成公钥文件(id_rsa.pub)和私钥文件(id_rsa)。

2、 分发公钥

[hadoop@bigdata-senior01 hadoop-2.5.0]$ ssh-copy-id bigdata-senior01.chybinmy.com[hadoop@bigdata-senior01 hadoop-2.5.0]$ ssh-copy-id bigdata-senior02.chybinmy.com[hadoop@bigdata-senior01 hadoop-2.5.0]$ ssh-copy-id bigdata-senior03.chybinmy.com123

3、 设置BigData02、BigData03到其他机器的无密钥登录

同样的在BigData02、BigData03上生成公钥和私钥后,将公钥分发到三台机器上。

二十九、分发Hadoop文件

1、 首先在其他两台机器上创建存放Hadoop的目录

[hadoop@bigdata-senior02 ~]$ mkdir /opt/modules/app[hadoop@bigdata-senior03 ~]$ mkdir /opt/modules/app12

2、 通过Scp分发

Hadoop根目录下的share/doc目录是存放的hadoop的文档,文件相当大,建议在分发之前将这个目录删除掉,可以节省硬盘空间并能提高分发的速度。

doc目录大小有1.6G。

[hadoop@bigdata-senior01 hadoop-2.5.0]$ du -sh /opt/modules/app/hadoop-2.5.0/share/doc1.6G /opt/modules/app/hadoop-2.5.0/share/doc[hadoop@bigdata-senior01 hadoop-2.5.0]$ scp -r /opt/modules/app/hadoop-2.5.0/ bigdata-senior02.chybinmy.com:/opt/modules/app[hadoop@bigdata-senior01 hadoop-2.5.0]$ scp -r /opt/modules/app/hadoop-2.5.0/ bigdata-senior03.chybinmy.com:/opt/modules/app1234

三十、格式NameNode

在NameNode机器上执行格式化:

[hadoop@bigdata-senior01 hadoop-2.5.0]$ /opt/modules/app/hadoop-2.5.0/bin/hdfs namenode –format1

注意:

如果需要重新格式化NameNode,需要先将原来NameNode和DataNode下的文件全部删除,不然会报错,NameNode和DataNode所在目录是在core-site.xml中hadoop.tmp.dir、dfs.namenode.name.dir、dfs.datanode.data.dir属性配置的。

<property><name>hadoop.tmp.dir</name><value>/opt/data/tmp</value></property><property><name>dfs.namenode.name.dir</name><value>file://${hadoop.tmp.dir}/dfs/name</value></property><property><name>dfs.datanode.data.dir</name><value>file://${hadoop.tmp.dir}/dfs/data</value></property>123456789101112因为每次格式化,默认是创建一个集群ID,并写入NameNode和DataNode的VERSION文件中(VERSION文件所在目录为dfs/name/current 和 dfs/data/current),重新格式化时,默认会生成一个新的集群ID,如果不删除原来的目录,会导致namenode中的VERSION文件中是新的集群ID,而DataNode中是旧的集群ID,不一致时会报错。

另一种方法是格式化时指定集群ID参数,指定为旧的集群ID。

三十一、启动集群

1、 启动HDFS

[hadoop@bigdata-senior01 hadoop-2.5.0]$ /opt/modules/app/hadoop-2.5.0/sbin/start-dfs.sh1

2、 启动YARN

[hadoop@bigdata-senior01 hadoop-2.5.0]$ /opt/modules/app/hadoop-2.5.0/sbin/start-yarn.sh1

在BigData02上启动ResourceManager:

[hadoop@bigdata-senior02 hadoop-2.5.0]$ sbin/yarn-daemon.sh start resourcemanager1

3、 启动日志服务器

因为我们规划的是在BigData03服务器上运行MapReduce日志服务,所以要在BigData03上启动。

[hadoop@bigdata-senior03 ~]$ /opt/modules/app/hadoop-2.5.0/sbin/mr-jobhistory-daemon.sh start historyserverstarting historyserver, logging to /opt/modules/app/hadoop-2.5.0/logs/mapred-hadoop-historyserver-bigda ta-senior03.chybinmy.com.out12

[hadoop@bigdata-senior03 ~]$ jps3570 Jps3537 JobHistoryServer3310 SecondaryNameNode3213 DataNode3392 NodeManager123456

4、 查看HDFS Web页面

http://bigdata-senior01.chybinmy.com:50070/

5、 查看YARN Web 页面

http://bigdata-senior02.chybinmy.com:8088/cluster

三十二、测试Job

我们这里用hadoop自带的wordcount例子来在本地模式下测试跑mapreduce。

1、 准备mapreduce输入文件wc.input

[hadoop@bigdata-senior01 modules]$ cat /opt/data/wc.inputhadoop mapreduce hivehbase spark stormsqoop hadoop hivespark hadoop12345

2、 在HDFS创建输入目录input

[hadoop@bigdata-senior01 hadoop-2.5.0]$ bin/hdfs dfs -mkdir /input1

3、 将wc.input上传到HDFS

[hadoop@bigdata-senior01 hadoop-2.5.0]$ bin/hdfs dfs -put /opt/data/wc.input /input/wc.input1

4、 运行hadoop自带的mapreduce Demo

[hadoop@bigdata-senior01 hadoop-2.5.0]$ bin/yarn jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.5.0.jar wordcount /input/wc.input /output1

5、 查看输出文件

[hadoop@bigdata-senior01 hadoop-2.5.0]$ bin/hdfs dfs -ls /outputFound 2 items-rw-r--r-- 3 hadoop supergroup 0 2016-07-14 16:36 /output/_SUCCESS-rw-r--r-- 3 hadoop supergroup 60 2016-07-14 16:36 /output/part-r-000001234

第五部分:Hadoop HA安装

HA的意思是High Availability高可用,指当当前工作中的机器宕机后,会自动处理这个异常,并将工作无缝地转移到其他备用机器上去,以来保证服务的高可用。

HA方式安装部署才是最常见的生产环境上的安装部署方式。Hadoop HA是Hadoop 2.x中新添加的特性,包括NameNode HA 和 ResourceManager HA。因为DataNode和NodeManager本身就是被设计为高可用的,所以不用对他们进行特殊的高可用处理。

第九步、时间服务器搭建

Hadoop对集群中各个机器的时间同步要求比较高,要求各个机器的系统时间不能相差太多,不然会造成很多问题。可以配置集群中各个机器和互联网的时间服务器进行时间同步,但是在实际生产环境中,集群中大部分服务器是不能连接外网的,这时候可以在内网搭建一个自己的时间服务器(NTP服务器),集群的各个机器与这个时间服务器进行时间同步。

三十三、配置NTP服务器

我们选择第三台机器(bigdata-senior03.chybinmy.com)为NTF服务器,其他机器和这台机器进行同步。

1、 检查ntp服务是否已经安装

[hadoop@bigdata-senior03 data]$ sudo rpm -qa | grep ntpntpdate-4.2.6p5-1.el6.centos.x86_64ntp-4.2.6p5-1.el6.centos.x86_64123

显示已经安装过了ntp程序,其中ntpdate-4.2.6p5-1.el6.centos.x86_64 是用来和某台服务器进行同步的,ntp-4.2.6p5-1.el6.centos.x86_64是用来提供时间同步服务的。

2、 修改配置文件ntp.conf

[hadoop@bigdata-senior03 data]$ vim /etc/ntp.conf1

启用restrice,修改网段

restrict 192.168.100.0 mask 255.255.255.0 nomodify notrap

将这行的注释去掉,并且将网段改为集群的网段,我们这里是100网段。

注释掉server域名配置

#server 0.centos.pool.ntp.org iburst#server 1.centos.pool.ntp.org iburst#server 2.centos.pool.ntp.org iburst#server 3.centos.pool.ntp.org iburst1234

是时间服务器的域名,这里不需要连接互联网,所以将他们注释掉。

修改

server 127.127.1.0

fudge 127.127.1.0 stratum 10

3、 修改配置文件ntpd

[hadoop@bigdata-senior03 ~]$ sudo vim /etc/sysconfig/ntpd1

添加一行配置:SYNC_CLOCK=yes

4、 启动ntp服务

[hadoop@bigdata-senior03 ~]$ sudo chkconfig ntpd on1

这样每次机器启动时,ntp服务都会自动启动。

三十四、配置其他机器的同步

切换到root用户进行配置通过contab进行定时同步:

[root@bigdata-senior02 hadoop]# crontab -e*/10 * * * * /usr/sbin/ntpdate bigdata-senior03.chybinmy.com[root@bigdata-senior02 hadoop]# crontab -e*/10 * * * * /usr/sbin/ntpdate bigdata-senior03.chybinmy.com1234

三十五、 测试同步是否有效

1、 查看目前三台机器的时间

[hadoop@bigdata-senior03 ~]$ date "+%Y-%m-%d %H:%M:%S"2016-09-23 16:43:56[hadoop@bigdata-senior02 ~]$ date "+%Y-%m-%d %H:%M:%S"2016-09-23 16:44:08[hadoop@bigdata-senior01 data]$ date "+%Y-%m-%d %H:%M:%S"2016-09-23 16:44:18123456

2、 修改bigdata-senior01上的时间

将时间改为一个以前的时间:

[hadoop@bigdata-senior01 data]$ sudo date -s '2016-01-01 00:00:00'Fri Jan 1 00:00:00 CST 2016[hadoop@bigdata-senior01 data]$ date "+%Y-%m-%d %H:%M:%S"2016-01-01 00:00:051234

等10分钟,看是否可以实现自动同步,将bigdata-senior01上的时间修改为和bigdata-senior03上的一致。

3、 查看是否自动同步时间

[hadoop@bigdata-senior01 data]$ date "+%Y-%m-%d %H:%M:%S"2016-09-23 16:54:3612

可以看到bigdata-senior01上的时间已经实现自动同步了。

第十步、Zookeeper分布式机器部署

三十六、zookeeper说明

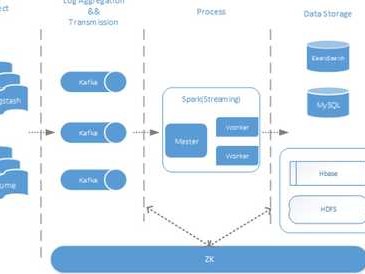

Zookeeper在Hadoop集群中的作用。

Zookeeper是分布式管理协作框架,Zookeeper集群用来保证Hadoop集群的高可用,(高可用的含义是:集群中就算有一部分服务器宕机,也能保证正常地对外提供服务。)

Zookeeper保证高可用的原理。

Zookeeper集群能够保证NamaNode服务高可用的原理是:Hadoop集群中有两个NameNode服务,两个NaameNode都定时地给Zookeeper发送心跳,告诉Zookeeper我还活着,可以提供服务,单某一个时间只有一个是Action状态,另外一个是Standby状态,一旦Zookeeper检测不到Action NameNode发送来的心跳后,就切换到Standby状态的NameNode上,将它设置为Action状态,所以集群中总有一个可用的NameNode,达到了NameNode的高可用目的。

Zookeeper的选举机制。

Zookeeper集群也能保证自身的高可用,保证自身高可用的原理是,Zookeeper集群中的各个机器分为Leader和Follower两个角色,写入数据时,要先写入Leader,Leader同意写入后,再通知Follower写入。客户端读取数时,因为数据都是一样的,可以从任意一台机器上读取数据。

这里Leader角色就存在单点故障的隐患,高可用就是解决单点故障隐患的。Zookeeper从机制上解决了Leader的单点故障问题,Leader是哪一台机器是不固定的,Leader是选举出来的。选举流程是,集群中任何一台机器发现集群中没有Leader时,就推荐自己为Leader,其他机器来同意,当超过一半数的机器同意它为Leader时,选举结束,所以Zookeeper集群中的机器数据必须是奇数。这样就算当Leader机器宕机后,会很快选举出新的Leader,保证了Zookeeper集群本身的高可用。

写入高可用。

集群中的写入操作都是先通知Leader,Leader再通知Follower写入,实际上当超过一半的机器写入成功后,就认为写入成功了,所以就算有些机器宕机,写入也是成功的。

读取高可用。

zookeeperk客户端读取数据时,可以读取集群中的任何一个机器。所以部分机器的宕机并不影响读取。

zookeeper服务器必须是奇数台,因为zookeeper有选举制度,角色有:领导者、跟随者、观察者,选举的目的是保证集群中数据的一致性。

三十七、安装zookeeper

我们这里在BigData01、BigData02、BigData03三台机器上安装zookeeper集群。

1、 解压安装包

在BigData01上安装解压zookeeper安装包。

[hadoop@bigdata-senior01 hadoop-2.5.0]$ tar -zxf /opt/sofeware/zookeeper-3.4.8.tar.gz -C /opt/modules/1

2、 修改配置

拷贝conf下的zoo_sample.cfg副本,改名为zoo.cfg。zoo.cfg是zookeeper的配置文件:

[hadoop@bigdata-senior01 zookeeper-3.4.8]$ cp conf/zoo_sample.cfg conf/zoo.cfg1

dataDir属性设置zookeeper的数据文件存放的目录:

dataDir=/opt/modules/zookeeper-3.4.8/data/zData

指定zookeeper集群中各个机器的信息:

server.1=bigdata-senior01.chybinmy.com:2888:3888server.2=bigdata-senior02.chybinmy.com:2888:3888server.3=bigdata-senior03.chybinmy.com:2888:3888123

server后面的数字范围是1到255,所以一个zookeeper集群最多可以有255个机器。

3、 创建myid文件

在dataDir所指定的目录下创一个名为myid的文件,文件内容为server点后面的数字。

4、 分发到其他机器

[hadoop@bigdata-senior01 zookeeper-3.4.8]$ scp -r /opt/modules/zookeeper-3.4.8 bigdata-senior02.chybinmy.com:/opt/modules[hadoop@bigdata-senior01 zookeeper-3.4.8]$ scp -r /opt/modules/zookeeper-3.4.8 bigdata-senior03.chybinmy.com:/opt/modules12

5、 修改其他机器上的myid文件

[hadoop@bigdata-senior02 zookeeper-3.4.8]$ echo 2 > /opt/modules/zookeeper-3.4.8/data/zData/myid[hadoop@bigdata-senior02 zookeeper-3.4.8]$ cat /opt/modules/zookeeper-3.4.8/data/zData/myid2123

[hadoop@bigdata-senior03 ~]$ echo 3 > /opt/modules/zookeeper-3.4.8/data/zData/myid[hadoop@bigdata-senior03 ~]$ cat /opt/modules/zookeeper-3.4.8/data/zData/myid3123

6、 启动zookeeper

需要在各个机器上分别启动zookeeper。

[hadoop@bigdata-senior01 zookeeper-3.4.8]$ bin/zkServer.sh start[hadoop@bigdata-senior02 zookeeper-3.4.8]$ bin/zkServer.sh start[hadoop@bigdata-senior03 zookeeper-3.4.8]$ bin/zkServer.sh start123

三十八、zookeeper命令

进入zookeeper Shell

在zookeeper根目录下执行 bin/zkCli.sh进入zk shell模式。

zookeeper很像一个小型的文件系统,/是根目录,下面的所有节点都叫zNode。

进入zk shell 后输入任意字符,可以列出所有的zookeeper命令

查询zNode上的数据:get /zookeeper

创建一个zNode : create /znode1 “demodata “

列出所有子zNode:ls /

删除znode : rmr /znode1

退出shell模式:quit

第十一步、Hadoop 2.x HDFS HA 部署

三十九、HDFS HA原理

单NameNode的缺陷存在单点故障的问题,如果NameNode不可用,则会导致整个HDFS文件系统不可用。所以需要设计高可用的HDFS(Hadoop HA)来解决NameNode单点故障的问题。解决的方法是在HDFS集群中设置多个NameNode节点。但是一旦引入多个NameNode,就有一些问题需要解决。

HDFS HA需要保证的四个问题:

保证NameNode内存中元数据数据一致,并保证编辑日志文件的安全性。

多个NameNode如何协作

客户端如何能正确地访问到可用的那个NameNode。

怎么保证任意时刻只能有一个NameNode处于对外服务状态。

解决方法

对于保证NameNode元数据的一致性和编辑日志的安全性,采用Zookeeper来存储编辑日志文件。

两个NameNode一个是Active状态的,一个是Standby状态的,一个时间点只能有一个Active状态的

NameNode提供服务,两个NameNode上存储的元数据是实时同步的,当Active的NameNode出现问题时,通过Zookeeper实时切换到Standby的NameNode上,并将Standby改为Active状态。

客户端通过连接一个Zookeeper的代理来确定当时哪个NameNode处于服务状态。

四十、HDFS HA架构图

HDFS HA架构中有两台NameNode节点,一台是处于活动状态(Active)为客户端提供服务,另外一台处于热备份状态(Standby)。

元数据文件有两个文件:fsimage和edits,备份元数据就是备份这两个文件。JournalNode用来实时从Active NameNode上拷贝edits文件,JournalNode有三台也是为了实现高可用。

Standby NameNode不对外提供元数据的访问,它从Active NameNode上拷贝fsimage文件,从JournalNode上拷贝edits文件,然后负责合并fsimage和edits文件,相当于SecondaryNameNode的作用。最终目的是保证Standby NameNode上的元数据信息和Active NameNode上的元数据信息一致,以实现热备份。

Zookeeper来保证在Active NameNode失效时及时将Standby NameNode修改为Active状态。

ZKFC(失效检测控制)是Hadoop里的一个Zookeeper客户端,在每一个NameNode节点上都启动一个ZKFC进程,来监控NameNode的状态,并把NameNode的状态信息汇报给Zookeeper集群,其实就是在Zookeeper上创建了一个Znode节点,节点里保存了NameNode状态信息。当NameNode失效后,ZKFC检测到报告给Zookeeper,Zookeeper把对应的Znode删除掉,Standby ZKFC发现没有Active状态的NameNode时,就会用shell命令将自己监控的NameNode改为Active状态,并修改Znode上的数据。

Znode是个临时的节点,临时节点特征是客户端的连接断了后就会把znode删除,所以当ZKFC失效时,也会导致切换NameNode。

DataNode会将心跳信息和Block汇报信息同时发给两台NameNode,DataNode只接受Active NameNode发来的文件读写操作指令。

四十一、搭建HDFS HA 环境

1、 服务器角色规划

| bigdata-senior01.chybinmy.com | bigdata-senior01.chybinmy.com | bigdata-senior01.chybinmy.com |

|---|

| NameNode | NameNode |

|

| Zookeeper | Zookeeper | Zookeeper |

| DataNode | DataNode | DataNode |

| ResourceManage | ResourceManage |

| NodeManager | NodeManager | NodeManager |

2、 创建HDFS HA 版本Hadoop程序目录

在bigdata01、bigdata02、bigdata03三台机器上分别创建目录/opt/modules/hadoopha/用来存放Hadoop HA环境。

[hadoop@bigdata-senior01 modules]$ mkdir /opt/modules/hadoopha1

3、 新解压Hadoop 2.5.0

[hadoop@bigdata-senior01 ~]$ tar -zxf /opt/sofeware/hadoop-2.5.0.tar.gz -C /opt/modules/hadoopha/1

4、 配置Hadoop JDK路径

修改hadoop-env.sh、mapred-env.sh、yarn-env.sh文件中的JDK路径export JAVA_HOME="/opt/modules/jdk1.7.0_67"12

5、 配置hdfs-site.xml

<?xml version="1.0" encoding="UTF-8"?><configuration><property><!-- 为namenode集群定义一个services name --><name>dfs.nameservices</name><value>ns1</value></property><property><!-- nameservice 包含哪些namenode,为各个namenode起名 --><name>dfs.ha.namenodes.ns1</name><value>nn1,nn2</value></property><property><!-- 名为nn1的namenode 的rpc地址和端口号,rpc用来和datanode通讯 --><name>dfs.namenode.rpc-address.ns1.nn1</name><value>bigdata-senior01.chybinmy.com:8020</value></property><property><!-- 名为nn2的namenode 的rpc地址和端口号,rpc用来和datanode通讯 --><name>dfs.namenode.rpc-address.ns1.nn2</name><value>bigdata-senior02.chybinmy.com:8020</value></property><property><!--名为nn1的namenode 的http地址和端口号,web客户端 --><name>dfs.namenode.http-address.ns1.nn1</name><value>bigdata-senior01.chybinmy.com:50070</value></property><property><!--名为nn2的namenode 的http地址和端口号,web客户端 --><name>dfs.namenode.http-address.ns1.nn2</name><value>bigdata-senior02.chybinmy.com:50070</value></property><property><!-- namenode间用于共享编辑日志的journal节点列表 --><name>dfs.namenode.shared.edits.dir</name><value>qjournal://bigdata-senior01.chybinmy.com:8485;bigdata-senior02.chybinmy.com:8485;bigdata-senior03.chybinmy.com:8485/ns1</value></property><property><!-- journalnode 上用于存放edits日志的目录 --><name>dfs.journalnode.edits.dir</name><value>/opt/modules/hadoopha/hadoop-2.5.0/tmp/data/dfs/jn</value></property><property><!-- 客户端连接可用状态的NameNode所用的代理类 --><name>dfs.client.failover.proxy.provider.ns1</name><value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value></property><property><!-- --><name>dfs.ha.fencing.methods</name><value>sshfence</value></property><property><name>dfs.ha.fencing.ssh.private-key-files</name><value>/home/hadoop/.ssh/id_rsa</value></property></configuration>12345678910111213141516171819202122232425262728293031323334353637383940414243444546474849505152535455565758

6、 配置core-site.xml

<?xml version="1.0" encoding="UTF-8"?><configuration><property><!-- hdfs 地址,ha中是连接到nameservice --><name>fs.defaultFS</name><value>hdfs://ns1</value></property><property><!-- --><name>hadoop.tmp.dir</name><value>/opt/modules/hadoopha/hadoop-2.5.0/data/tmp</value></property></configuration>1234567891011121314

hadoop.tmp.dir设置hadoop临时目录地址,默认时,NameNode和DataNode的数据存在这个路径下。

7、 配置slaves文件

bigdata-senior01.chybinmy.combigdata-senior02.chybinmy.combigdata-senior03.chybinmy.com123

8、 分发到其他节点

分发之前先将share/doc目录删除,这个目录中是帮助文件,并且很大,可以删除。

[hadoop@bigdata-senior01 hadoop-2.5.0]$ scp -r /opt/modules/hadoopha bigdata-senior02.chybinmy.com:/opt/modules[hadoop@bigdata-senior01 hadoop-2.5.0]$ scp -r /opt/modules/hadoopha bigdata-senior03.chybinmy.com:/opt/modules12

9、 启动HDFS HA集群

三台机器分别启动Journalnode。

[hadoop@bigdata-senior01 hadoop-2.5.0]$ sbin/hadoop-daemon.sh start journalnode[hadoop@bigdata-senior02 hadoop-2.5.0]$ sbin/hadoop-daemon.sh start journalnode[hadoop@bigdata-senior03 hadoop-2.5.0]$ sbin/hadoop-daemon.sh start journalnode123

jps命令查看是否启动。

10、 启动Zookeeper

在三台节点上启动Zookeeper:

[hadoop@bigdata-senior01 zookeeper-3.4.8]$ bin/zkServer.sh start[hadoop@bigdata-senior02 zookeeper-3.4.8]$ bin/zkServer.sh start[hadoop@bigdata-senior03 zookeeper-3.4.8]$ bin/zkServer.sh start123

11、 格式化NameNode

在第一台上进行NameNode格式化:

[hadoop@bigdata-senior01 hadoop-2.5.0]$ bin/hdfs namenode -format1

在第二台NameNode上:

[hadoop@bigdata-senior02 hadoop-2.5.0]$ bin/hdfs namenode -bootstrapStandby1

12、 启动NameNode

在第一台、第二台上启动NameNode:

[hadoop@bigdata-senior01 hadoop-2.5.0]$ sbin/hadoop-daemon.sh start namenode[hadoop@bigdata-senior02 hadoop-2.5.0]$ sbin/hadoop-daemon.sh start namenode12

查看HDFS Web页面,此时两个NameNode都是standby状态。

切换第一台为active状态:

[hadoop@bigdata-senior01 hadoop-2.5.0]$ bin/hdfs haadmin -transitionToActive nn11

可以添加上forcemanual参数,强制将一个NameNode转换为Active状态。

[hadoop@bigdata-senior01 hadoop-2.5.0]$ bin/hdfs haadmin –transitionToActive -forcemanual nn11

此时从web 页面就看到第一台已经是active状态了。

13、 配置故障自动转移

利用zookeeper集群实现故障自动转移,在配置故障自动转移之前,要先关闭集群,不能在HDFS运行期间进行配置。

关闭NameNode、DataNode、JournalNode、zookeeper

[hadoop@bigdata-senior01 hadoop-2.5.0]$ sbin/hadoop-daemon.sh stop namenode[hadoop@bigdata-senior01 hadoop-2.5.0]$ sbin/hadoop-daemon.sh stop datanode[hadoop@bigdata-senior01 hadoop-2.5.0]$ sbin/hadoop-daemon.sh stop journalnode[hadoop@bigdata-senior01 hadoop-2.5.0]$ cd ../../zookeeper-3.4.8/[hadoop@bigdata-senior01 zookeeper-3.4.8]$ bin/zkServer.sh stop[hadoop@bigdata-senior02 hadoop-2.5.0]$ sbin/hadoop-daemon.sh stop namenode[hadoop@bigdata-senior02 hadoop-2.5.0]$ sbin/hadoop-daemon.sh stop datanode[hadoop@bigdata- senior02 hadoop-2.5.0]$ sbin/hadoop-daemon.sh stop journalnode[hadoop@bigdata- senior02 hadoop-2.5.0]$ cd ../../zookeeper-3.4.8/[hadoop@bigdata- senior02 zookeeper-3.4.8]$ bin/zkServer.sh stop[hadoop@bigdata- senior03 hadoop-2.5.0]$ sbin/hadoop-daemon.sh stop datanode[hadoop@bigdata- senior03 hadoop-2.5.0]$ sbin/hadoop-daemon.sh stop journalnode[hadoop@bigdata- senior03 hadoop-2.5.0]$ cd ../../zookeeper-3.4.8/[hadoop@bigdata- senior03 zookeeper-3.4.8]$ bin/zkServer.sh stop1234567891011121314

修改hdfs-site.xml

<property><name>dfs.ha.automatic-failover.enabled</name><value>true</value></property>1234

修改core-site.xml

<property><name>ha.zookeeper.quorum</name><value>bigdata-senior01.chybinmy.com:2181,bigdata-senior02.chybinmy.com:2181,bigdata-senior03.chybinmy.com:2181</value></property>1234

将hdfs-site.xml和core-site.xml分发到其他机器

[hadoop@bigdata-senior01 hadoop-2.5.0]$ scp /opt/modules/hadoopha/hadoop-2.5.0/etc/hadoop/hdfs-site.xml bigdata-senior02.chybinmy.com:/opt/modules/hadoopha/hadoop-2.5.0/etc/hadoop/[hadoop@bigdata-senior01 hadoop-2.5.0]$ scp /opt/modules/hadoopha/hadoop-2.5.0/etc/hadoop/hdfs-site.xml bigdata-senior03.chybinmy.com:/opt/modules/hadoopha/hadoop-2.5.0/etc/hadoop/[hadoop@bigdata-senior01 hadoop-2.5.0]$ scp /opt/modules/hadoopha/hadoop-2.5.0/etc/hadoop/core-site.xml bigdata-senior02.chybinmy.com:/opt/modules/hadoopha/hadoop-2.5.0/etc/hadoop/[hadoop@bigdata-senior01 hadoop-2.5.0]$ scp /opt/modules/hadoopha/hadoop-2.5.0/etc/hadoop/core-site.xml bigdata-senior03.chybinmy.com:/opt/modules/hadoopha/hadoop-2.5.0/etc/hadoop/1234

启动zookeeper

三台机器启动zookeeper

[hadoop@bigdata-senior01 hadoop-2.5.0]$ /opt/modules/zookeeper-3.4.8/bin/zkServer.sh start1

创建一个zNode

[hadoop@bigdata-senior01 hadoop-2.5.0]$ cd /opt/modules/hadoopha/hadoop-2.5.0/[hadoop@bigdata-senior01 hadoop-2.5.0]$ bin/hdfs zkfc -formatZK12

在Zookeeper上创建一个存储namenode相关的节点。

14、 启动HDFS、JournalNode、zkfc

启动NameNode、DataNode、JournalNode、zkfc

[hadoop@bigdata-senior01 hadoop-2.5.0]$ sbin/start-dfs.sh1

zkfc只针对NameNode监听。

四十二、测试HDFS HA

1、 测试故障自动转移和数据是否共享

在nn1上上传文件

目前bigdata-senior01节点上的NameNode是Active状态的。

[hadoop@bigdata-senior01 hadoop-2.5.0]$ bin/hdfs dfs -put /opt/data/wc.input /1

将nn1上的NodeNode进程杀掉

[hadoop@bigdata-senior01 hadoop-2.5.0]$ kill -9 33641

nn1上的namenode已经无法访问了。

查看nn2是否是Active状态

在nn2上查看是否看见文件

经以上验证,已经实现了nn1和nn2之间的文件同步和故障自动转移。

第十二步、Hadoop 2.x YARN HA 部署

四十三、YARN HA原理

Hadoop2.4版本之前,ResourceManager也存在单点故障的问题,也需要实现HA来保证ResourceManger的高可也用性。

ResouceManager从记录着当前集群的资源分配情况和JOB的运行状态,YRAN HA 利用Zookeeper等共享存储介质来存储这些信息来达到高可用。另外利用Zookeeper来实现ResourceManager自动故障转移。

MasterHADaemon:控制RM的 Master的启动和停止,和RM运行在一个进程中,可以接收外部RPC命令。

共享存储:Active Master将信息写入共享存储,Standby Master读取共享存储信息以保持和Active Master同步。

ZKFailoverController:基于Zookeeper实现的切换控制器,由ActiveStandbyElector和HealthMonitor组成,ActiveStandbyElector负责与Zookeeper交互,判断所管理的Master是进入Active还是Standby;HealthMonitor负责监控Master的活动健康情况,是个监视器。

Zookeeper:核心功能是维护一把全局锁控制整个集群上只有一个Active的ResourceManager。

四十四、搭建YARN HA环境

1、 服务器角色规划

| bigdata-senior01.chybinmy.com | bigdata-senior01.chybinmy.com | bigdata-senior01.chybinmy.com |

|---|

| NameNode | NameNode |

|

| Zookeeper | Zookeeper | Zookeeper |

| DataNode | DataNode | DataNode |

| ResourceManage | ResourceManage |

| NodeManager | NodeManager | NodeManager |

2、 修改配置文件yarn-site.xml

<?xml version="1.0" encoding="UTF-8"?><configuration><property><name>yarn.nodemanager.aux-services</name><value>mapreduce_shuffle</value></property><property><name>yarn.log-aggregation-enable</name><value>true</value></property><property><name>yarn.log-aggregation.retain-seconds</name><value>106800</value></property><property><!-- 启用resourcemanager的ha功能 --><name>yarn.resourcemanager.ha.enabled</name><value>true</value></property><property><!-- 为resourcemanage ha 集群起个id --><name>yarn.resourcemanager.cluster-id</name><value>yarn-cluster</value></property><property><!-- 指定resourcemanger ha 有哪些节点名 --><name>yarn.resourcemanager.ha.rm-ids</name><value>rm12,rm13</value></property><property><!-- 指定第一个节点的所在机器 --><name>yarn.resourcemanager.hostname.rm12</name><value>bigdata-senior02.chybinmy.com</value></property><property><!-- 指定第二个节点所在机器 --><name>yarn.resourcemanager.hostname.rm13</name><value>bigdata-senior03.chybinmy.com</value></property><property><!-- 指定resourcemanger ha 所用的zookeeper 节点 --><name>yarn.resourcemanager.zk-address</name><value>bigdata-senior01.chybinmy.com:2181,bigdata-senior02.chybinmy.com:2181,bigdata-senior03.chybinmy.com:2181</value></property><property><!-- --><name>yarn.resourcemanager.recovery.enabled</name><value>true</value></property><property><!-- --><name>yarn.resourcemanager.store.class</name><value>org.apache.hadoop.yarn.server.resourcemanager.recovery.ZKRMStateStore</value></property></configuration>1234567891011121314151617181920212223242526272829303132333435363738394041424344454647484950515253545556

3、 分发到其他机器

[hadoop@bigdata-senior01 hadoop-2.5.0]$ scp /opt/modules/hadoopha/hadoop-2.5.0/etc/hadoop/yarn-site.xml bigdata-senior02.chybinmy.com:/opt/modules/hadoopha/hadoop-2.5.0/etc/hadoop/[hadoop@bigdata-senior01 hadoop-2.5.0]$ scp /opt/modules/hadoopha/hadoop-2.5.0/etc/hadoop/yarn-site.xml bigdata-senior03.chybinmy.com:/opt/modules/hadoopha/hadoop-2.5.0/etc/hadoop/\12

4、 启动

在bigdata-senior01上启动yarn:

[hadoop@bigdata-senior01 hadoop-2.5.0]$ sbin/start-yarn.sh1

在bigdata-senior02、bigdata-senior03上启动resourcemanager:

[hadoop@bigdata-senior02 hadoop-2.5.0]$ sbin/yarn-daemon.sh start resourcemanager[hadoop@bigdata-senior03 hadoop-2.5.0]$ sbin/yarn-daemon.sh start resourcemanager12

启动后各个节点的进程。

Web客户端访问bigdata02机器上的resourcemanager正常,它是active状态的。

http://bigdata-senior02.chybinmy.com:8088/cluster

访问另外一个resourcemanager,因为他是standby,会自动跳转到active的resourcemanager。

http://bigdata-senior03.chybinmy.com:8088/cluster

四十五、测试YARN HA

5、 运行一个mapreduce job

[hadoop@bigdata-senior01 hadoop-2.5.0]$ bin/yarn jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.5.0.jar wordcount /wc.input /input1

6、 在job运行过程中,将Active状态的resourcemanager进程杀掉。

[hadoop@bigdata-senior02 hadoop-2.5.0]$ kill -9 44751

7、 观察另外一个resourcemanager是否可以自动接替。

bigdata02的resourcemanage Web客户端已经不能访问,bigdata03的resourcemanage已经自动变为active状态。

8、 观察job是否可以顺利完成。

而mapreduce job 也能顺利完成,没有因为resourcemanager的意外故障而影响运行。

经过以上测试,已经验证YARN HA 已经搭建成功。

第十三步、HDFS Federation 架构部署

四十六、HDFS Federation 的使用原因

1、 单个NameNode节点的局限性

命名空间的限制。

NameNode上存储着整个HDFS上的文件的元数据,NameNode是部署在一台机器上的,因为单个机器硬件的限制,必然会限制NameNode所能管理的文件个数,制约了数据量的增长。

数据隔离问题。

整个HDFS上的文件都由一个NameNode管理,所以一个程序很有可能会影响到整个HDFS上的程序,并且权限控制比较复杂。

性能瓶颈。

单个NameNode时HDFS文件系统的吞吐量受限于单个NameNode的吞吐量。因为NameNode是个JVM进程,JVM进程所占用的内存很大时,性能会下降很多。

2、 HDFS Federation介绍

HDFS Federation是可以在Hadoop集群中设置多个NameNode,不同于HA中多个NameNode是完全一样的,是多个备份,Federation中的多个NameNode是不同的,可以理解为将一个NameNode切分为了多个NameNode,每一个NameNode只负责管理一部分数据。

HDFS Federation中的多个NameNode共用DataNode。

四十七、HDFS Federation的架构图

四十八、HDFS Federation搭建

1、 服务器角色规划

| bigdata-senior01.chybinmy.com | bigdata-senior01.chybinmy.com | bigdata-senior01.chybinmy.com |

|---|

| NameNode1 | NameNode2 | NameNode3 |

| ResourceManage |

|

| DataNode | DataNode | DataNode |

| NodeManager | NodeManager | NodeManager |

2、 创建HDFS Federation 版本Hadoop程序目录

在bigdata01上创建目录/opt/modules/hadoopfederation /用来存放Hadoop Federation环境。

[hadoop@bigdata-senior01 modules]$ mkdir /opt/modules/hadoopfederation1

3、 新解压Hadoop 2.5.0

[hadoop@bigdata-senior01 ~]$ tar -zxf /opt/sofeware/hadoop-2.5.0.tar.gz -C /opt/modules/hadoopfederation/1

4、 配置Hadoop JDK路径

修改hadoop-env.sh、mapred-env.sh、yarn-env.sh文件中的JDK路径。

export JAVA_HOME=”/opt/modules/jdk1.7.0_67”

5、 配置hdfs-site.xml

<configuration><property><!—配置三台NameNode --><name>dfs.nameservices</name><value>ns1,ns2,ns3</value></property><property><!—第一台NameNode的机器名和rpc端口,指定了NameNode和DataNode通讯用的端口号 --><name>dfs.namenode.rpc-address.ns1</name><value>bigdata-senior01.chybinmy.com:8020</value></property><property><!—第一台NameNode的机器名和rpc端口,备用端口号 --><name>dfs.namenode.serviceerpc-address.ns1</name><value>bigdata-senior01.chybinmy.com:8022</value></property><property><!—第一台NameNode的http页面地址和端口号 --><name>dfs.namenode.http-address.ns1</name><value>bigdata-senior01.chybinmy.com:50070</value></property><property><!—第一台NameNode的https页面地址和端口号 --><name>dfs.namenode.https-address.ns1</name><value>bigdata-senior01.chybinmy.com:50470</value></property><property><name>dfs.namenode.rpc-address.ns2</name><value>bigdata-senior02.chybinmy.com:8020</value></property><property><name>dfs.namenode.serviceerpc-address.ns2</name><value>bigdata-senior02.chybinmy.com:8022</value></property><property><name>dfs.namenode.http-address.ns2</name><value>bigdata-senior02.chybinmy.com:50070</value></property><property><name>dfs.namenode.https-address.ns2</name><value>bigdata-senior02.chybinmy.com:50470</value></property><property><name>dfs.namenode.rpc-address.ns3</name><value>bigdata-senior03.chybinmy.com:8020</value></property><property><name>dfs.namenode.serviceerpc-address.ns3</name><value>bigdata-senior03.chybinmy.com:8022</value></property><property><name>dfs.namenode.http-address.ns3</name><value>bigdata-senior03.chybinmy.com:50070</value></property><property><name>dfs.namenode.https-address.ns3</name><value>bigdata-senior03.chybinmy.com:50470</value></property></configuration>123456789101112131415161718192021222324252627282930313233343536373839404142434445464748495051525354555657585960616263

6、 配置core-site.xml

<configuration><property><name>hadoop.tmp.dir</name><value>/opt/modules/hadoopha/hadoop-2.5.0/data/tmp</value></property></configuration>123456

hadoop.tmp.dir设置hadoop临时目录地址,默认时,NameNode和DataNode的数据存在这个路径下。

7、 配置slaves文件

bigdata-senior01.chybinmy.combigdata-senior02.chybinmy.combigdata-senior03.chybinmy.com123

8、 配置yarn-site.xml

<configuration><property><name>yarn.nodemanager.aux-services</name><value>mapreduce_shuffle</value></property> <property><name>yarn.resourcemanager.hostname</name><value>bigdata-senior02.chybinmy.com</value></property> <property><name>yarn.log-aggregation-enable</name><value>true</value></property> <property><name>yarn.log-aggregation.retain-seconds</name><value>106800</value></property> </configuration>123456789101112131415161718

9、 分发到其他节点

分发之前先将share/doc目录删除,这个目录中是帮助文件,并且很大,可以删除。

[hadoop@bigdata-senior01 hadoop-2.5.0]$ scp -r /opt/modules/ /opt/modules/hadoopfederation bigdata-senior02.chybinmy.com:/opt/modules[hadoop@bigdata-senior01 hadoop-2.5.0]$ scp -r /opt/modules/hadoopfederation bigdata-senior03.chybinmy.com:/opt/modules12

10、 格式化NameNode

在第一台上进行NameNode格式化。

[hadoop@bigdata-senior01 hadoop-2.5.0]$ bin/hdfs namenode -format -clusterId hadoop-federation-clusterId1

这里一定要指定一个集群ID,使得多个NameNode的集群ID是一样的,因为这三个NameNode在同一个集群中,这里集群ID为hadoop-federation-clusterId。

在第二台NameNode上。

[hadoop@bigdata-senior02 hadoop-2.5.0]$ bin/hdfs namenode -format -clusterId hadoop-federation-clusterId1

在第二台NameNode上。

[hadoop@bigdata-senior03 hadoop-2.5.0]$ bin/hdfs namenode -format -clusterId hadoop-federation-clusterId1

11、 启动NameNode

在第一台、第二台、第三台机器上启动NameNode:

[hadoop@bigdata-senior01 hadoop-2.5.0]$ sbin/hadoop-daemon.sh start namenode[hadoop@bigdata-senior02 hadoop-2.5.0]$ sbin/hadoop-daemon.sh start namenode[hadoop@bigdata-senior03 hadoop-2.5.0]$ sbin/hadoop-daemon.sh start namenode123

启动后,用jps命令查看是否已经启动成功。

查看HDFS Web页面,此时三个NameNode都是standby状态。

12、 启动DataNode

[hadoop@bigdata-senior01 hadoop-2.5.0]$ sbin/hadoop-daemon.sh start datanode[hadoop@bigdata-senior02 hadoop-2.5.0]$ sbin/hadoop-daemon.sh start datanode[hadoop@bigdata-senior03 hadoop-2.5.0]$ sbin/hadoop-daemon.sh start datanode123

启动后,用jps命令确认DataNode进程已经启动成功。

四十九、测试HDFS Federation

1、 修改core-site.xml

在bigdata-senior01机器上,修改core-site.xml文件,指定连接的NameNode是第一台NameNode。

[hadoop@bigdata-senior01 hadoop-2.5.0]$ vim etc/hadoop/core-site.xml

<configuration><property><name>fs.defaultFS</name><value>hdfs://bigdata-senior01.chybinmy.com:8020</value></property><property><name>hadoop.tmp.dir</name><value>/opt/modules/hadoopfederation/hadoop-2.5.0/data/tmp</value></property></configuration>12345678910

2、 在bigdate-senior01上传一个文件到HDFS

[hadoop@bigdata-senior01 hadoop-2.5.0]$ bin/hdfs dfs -mkdir /tmp[hadoop@bigdata-senior01 hadoop-2.5.0]$ bin/hdfs dfs -put ~/shuffle_daily.sh /tmp/shuffle_daily.sh12

3、 查看HDFS文件

可以看到,刚才的文件只上传到了bigdate-senior01机器上的NameNode上了,并没有上传到其他的NameNode上去。

这样,在HDFS的客户端,可以指定要上传到哪个NameNode上,从而来达到了划分NameNode的目的。

后记

这篇文章的操作步骤并不是工作中标准的操作流程,如果在成百上千的机器全部这样安装会被累死,希望读者可以通过文章中一步步地安装,从而初步了解到Hadoop的组成部分,协助过程等,这对于Hadoop的深入使用有很大的帮助。

打赏

支付宝微信扫一扫,打赏作者吧~

本文链接:https://kinber.cn/post/1422.html 转载需授权!

推荐本站淘宝优惠价购买喜欢的宝贝:

您阅读本篇文章共花了:

您阅读本篇文章共花了:

支付宝微信扫一扫,打赏作者吧~

支付宝微信扫一扫,打赏作者吧~